即可将网页分享至朋友圈

近日,我校光电科学与工程学院2019级本科生陈芝漩在数学科学学院邓良剑特聘研究员的指导下,以第一作者身份撰写的论文“SpanConv: A New Convolution via Spanning Kernel Space for Lightweight Pansharpening”被人工智能领域顶级会议International Joint Conference on Artificial Intelligence(IJCAI 2022)接收,并获得了LONG oral presentation的机会。陈芝漩为论文第一作者,光电学院本科生金诚、英才学院本科生张添敬以及数学科学学院硕士研究生吴潇为论文合作作者,数学科学学院邓良剑特聘研究员为论文通讯作者。

IJCAI是中国计算机学会CCF-A类推荐国际会议。本年度会议投稿超过4500篇,录用率仅为15%,其中LONG oral presentation的机会仅为3.7%。本届会议将于7月在奥地利维也纳召开,届时陈芝漩同学将在会议上在线展示成果并做学术报告。

标准的卷积神经网络(CNN)因其能有效地对图像信息进行特征提取和表示,已在图像和视觉任务上获得了巨大的成功。但传统的标准卷积方式参数成本较高,限制了其在一些高维数据上的应用,如遥感图像处理问题。标准卷积方式参数量大的原因很大程度上是由于保持卷积核输入通道维度与特征通道一致而造成的参数冗余。此论文主要从线性代数理论的角度去理解卷积核的生成过程,并提出了一种可解释的卷积核张成策略SpanConv,有效且高效地构造卷积核空间,从而用更少的参数去表示卷积核的关键信息。

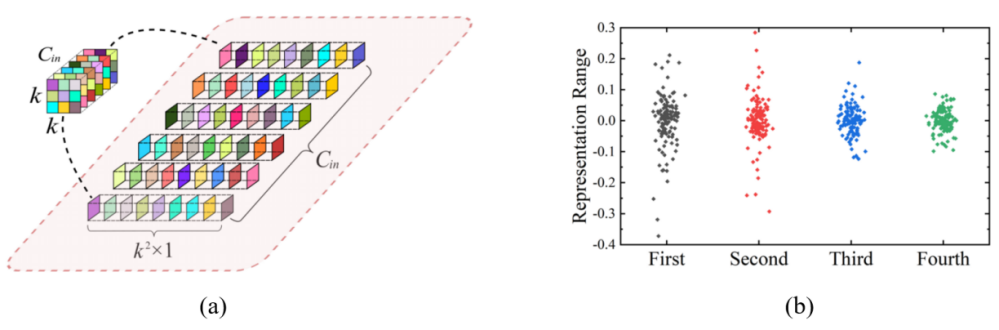

为了研究卷积核中存在的冗余,论文中首先对卷积核空间的性质进行分析。如图1(a)所示,如果将一个输入通道上的卷积核视为一个k2维的向量,一个输出通道上的卷积核便可看作一个Cin×k2大小的矩阵Fi。卷积核输入通道之间的相关性等价于该卷积核矩阵Fi行向量之间的线性相关性,即卷积核矩阵的低秩性。

图1. (a) 一个输出通道卷积核的矩阵形式可视化展示, (b) 128个卷积核向量经过主成分分析后前四个主成分分量的散点图表示。

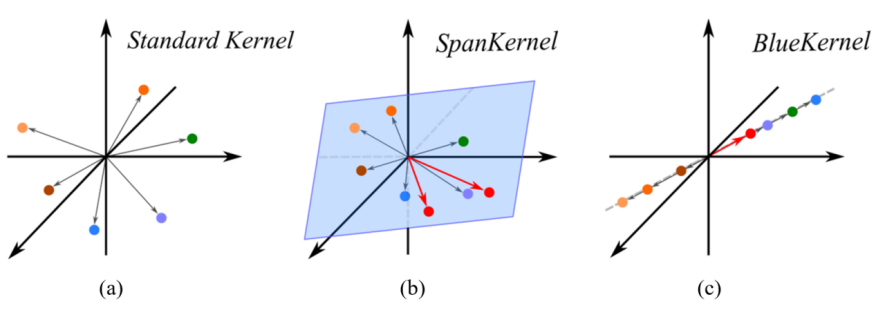

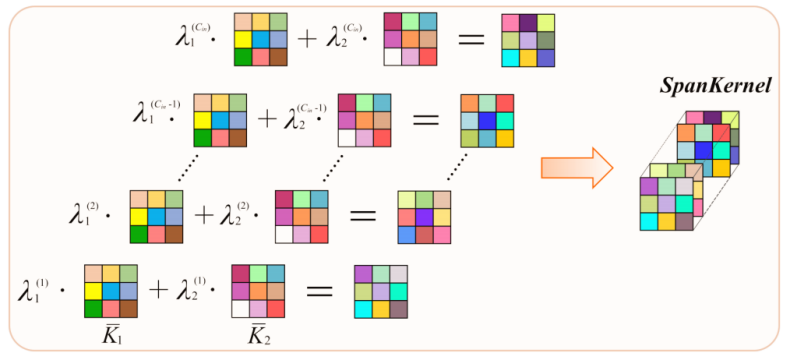

进一步,论文中采用主成分分析(PCA)对128个卷积核向量进行降维分析,绘制出包含卷积核前四个主成分分量的散点图(详见图1(b))。从图中可以看出,卷积核的前两个主成分分量上具有较大的表征范围(在此针对的是全色锐化任务,不同任务表征范围可能不同),而其余分量上的表征能力相对较弱。这说明一个维度为k2的卷积核向量,其主要信息只集中在前两个维度上。论文中分析,这是由于核向量分布在高维核空间里的某个子空间中,并从线性代数中无关向量组和子空间张成的理论对卷积网络参数表示进行了阐释(如图2),最后提出可以大大减少参数量的卷积核模块SpanKernel(构造过程如图3)。

图2. Standard Kernel、SpanKernel与BlueKernel在三维核空间中的简单示例。其中(a)图中展现的是Standard Kernel散布在核空间中的核向量。(b)图展现的是SpanKernel的核向量,其中蓝色平面代表基核向量展开的子空间,带红色箭头的向量表示子空间的一组基,所有的核向量都位于子空间上。(c)图是BlueKernel构造出的核向量,可以看出其中的核向量都是一个基向量展开的结果,即是SpanKernel基向量个数为1时的退化版本。

图3. SpanKernel的构造细节

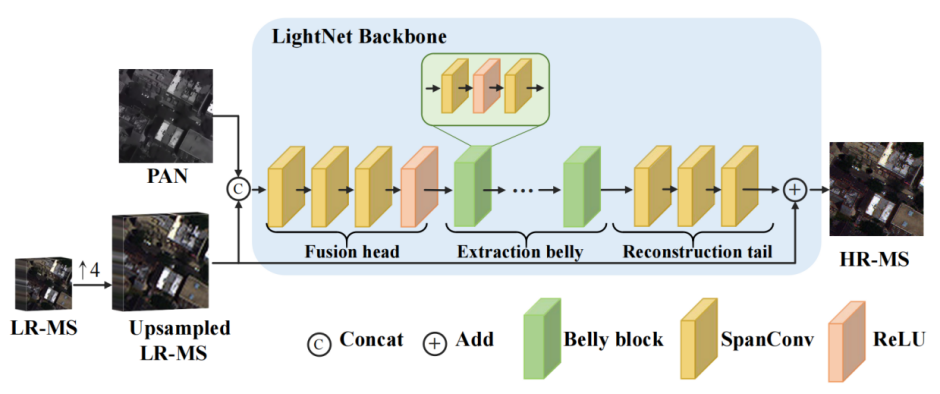

为了应用并验证这种新型的卷积核模块的效果,论文中设计了一个简单的轻量级网络架构LightNet(详见图4),并在遥感图像全色锐化这个任务上进行了实验验证。实验结果表明,搭载SpanConv的LightNet凭借着极少的参数量(仅1.6万)在多个卫星数据集上获得具有竞争力的效果,相比于其他当前最优的全色锐化深度学习方法具有最佳的泛化性能。

图4. 搭载SpanConv的LightNet网络架构图。

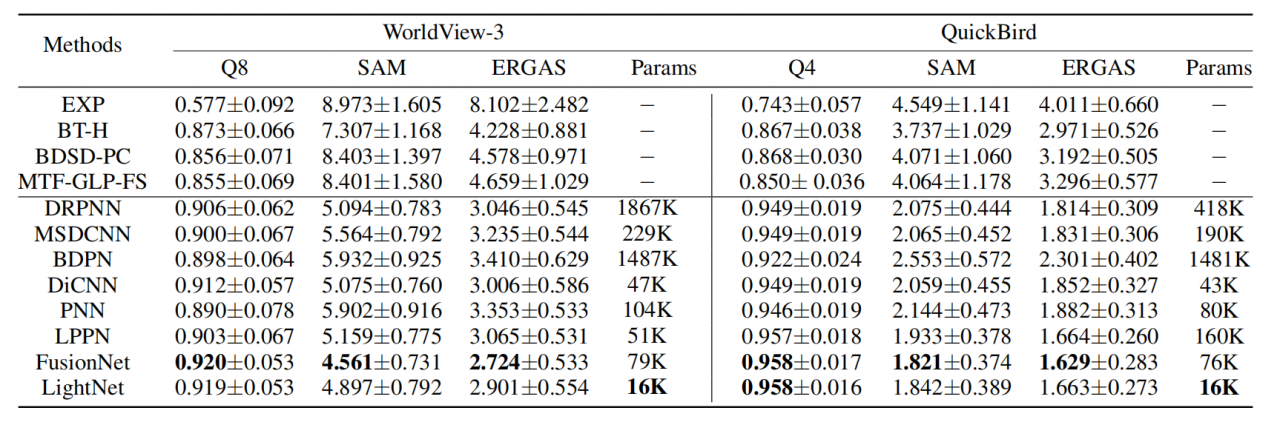

表1. 在WorldView3和QuickBird的reduced-resolution数据集上实验结果,LightNet凭借着16K的参数量超过了大部分基于深度学习和传统的方法,仅次于FusionNet。

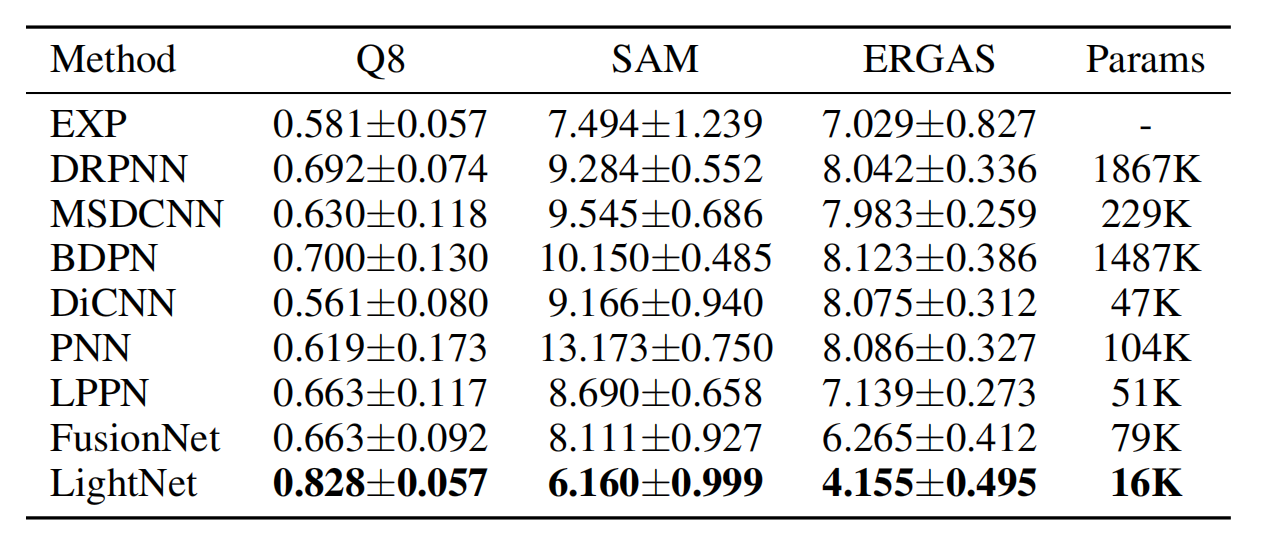

表2. 在WorldView3数据集上训练的模型在WorldView2数据集上的测试结果,以检验模型的泛化性能。结果表明,在比较的深度学习方法中,LightNet具有最佳的泛化性能。

陈芝漩同学于2021年开始在邓良剑特聘研究员的指导下从事轻量级神经网络设计与相关算法的研究工作。近年来,邓良剑已指导多名不同学院的本科生在高水平期刊和国际顶级会议上发表学术论文。

编辑:助理编辑 / 审核:林坤 / 发布:陈伟